於AI PC領域,NVIDIA持續與AI相關領域合作積極提升RTX GPU與AI的最佳化,NVIDIA CES宣布有越來越多的AI模型可支援NVFP4、NVFP8,相對BF16可進一步減少記憶體使用與提升性能;另外NVIDIA也將釋出LTX-2影像生成模型,主打支援NVFP8格式,可在20秒內產生4K影片;同時NVID於AI PC領域,NVIDIA持續與AI相關領域合作積極提升RTX GPU與AI的最佳化,NVIDIA CES宣布有越來越多的AI模型可支援NVFP4、NVFP8,相對BF16可進一步減少記憶體使用與提升性能;另外NVIDIA也將釋出LTX-2影像生成模型,主打支援NVFP8格式,可在20秒內產生4K影片;同時NVID

於AI PC領域,NVIDIA持續與AI相關領域合作積極提升RTX GPU與AI的最佳化,NVIDIA CES宣布有越來越多的AI模型可支援NVFP4、NVFP8,相對BF16可進一步減少記憶體使用與提升性能;另外NVIDIA也將釋出LTX-2影像生成模型,主打支援NVFP8格式,可在20秒內產生4K影片;同時NVIDIA也預計在2月釋出結合生成式AI的影片超解析技術,可在僅3分鐘完成過往需15分鐘自720p升級至4K的10秒影片。

支援NVFP4、NVFP8降低記憶體容量需求、提升效能

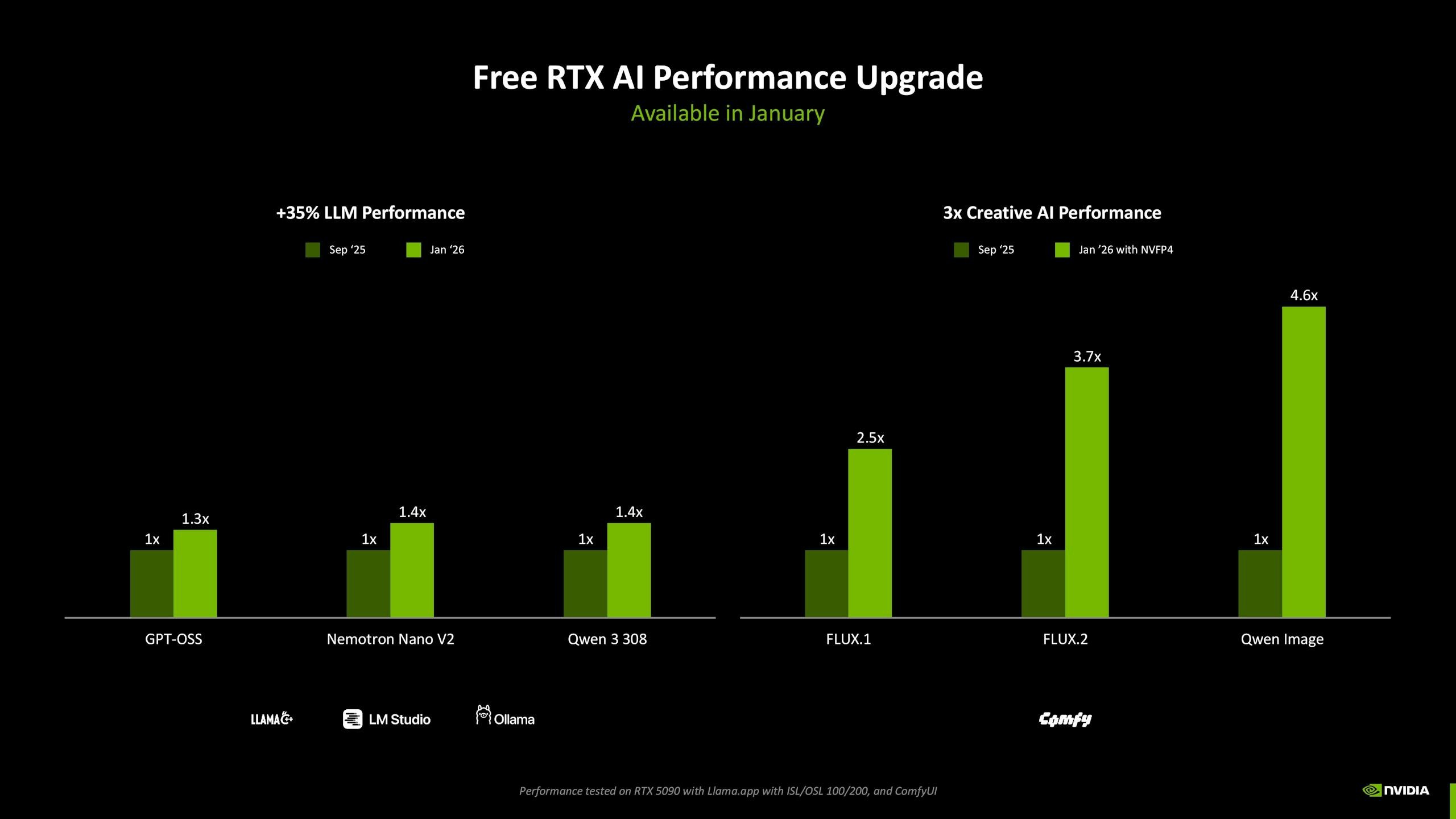

▲借助支援NVFP4、NVFP8格式,NVIDIA GPU執行特定AI模型的性能再次獲得顯著提升

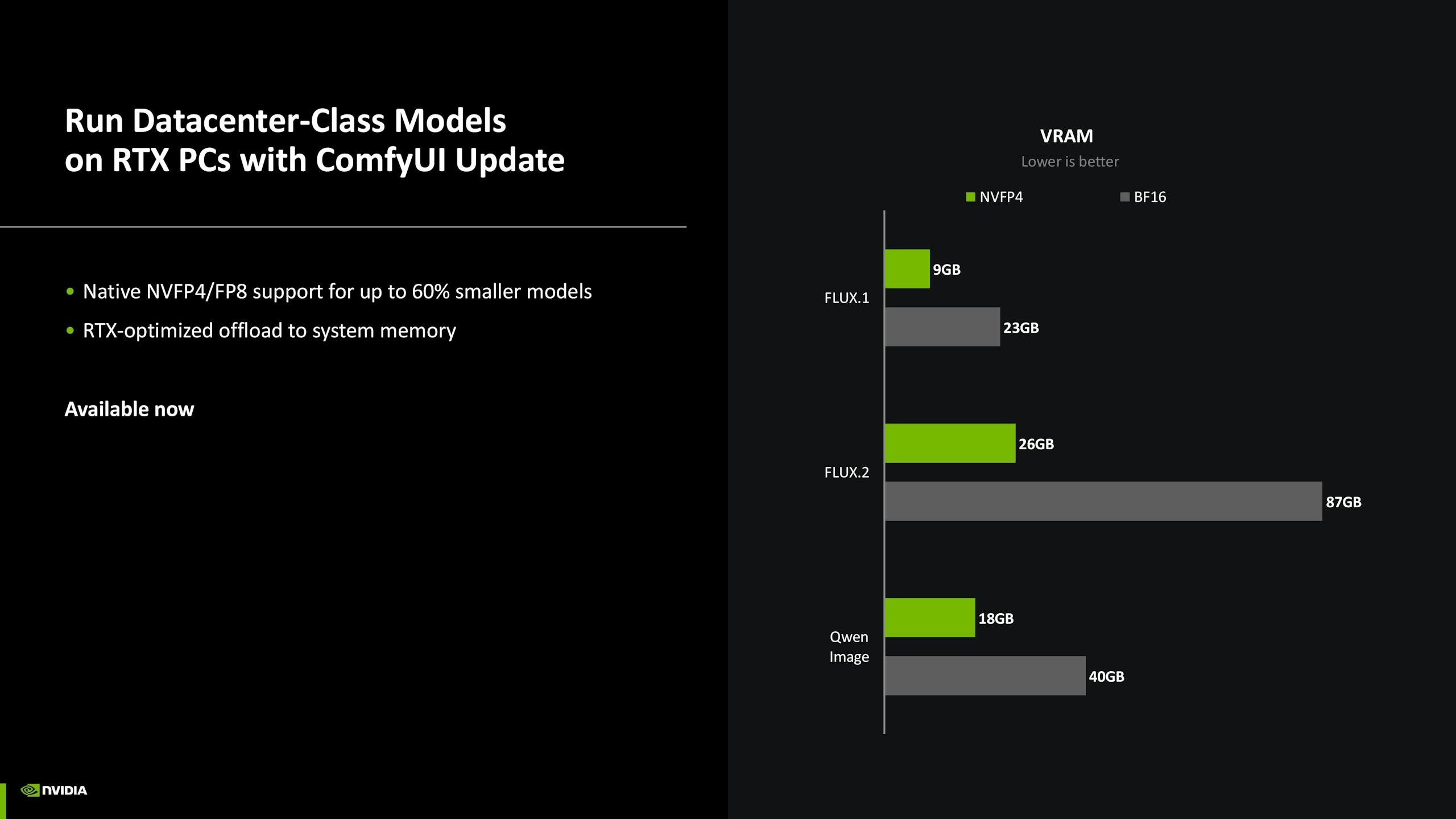

▲借助支援NVFP4、NVFP8格式,NVIDIA GPU執行特定AI模型的性能再次獲得顯著提升 ▲使用原生NVFP4、NVFP8使消費級顯示卡也能執行資料中心等級的AI模型

▲使用原生NVFP4、NVFP8使消費級顯示卡也能執行資料中心等級的AI模型

NVIDIA的RTX顯示卡率先支援NVFP4、NVFP8等量化格式,並證實可在不損失正確性且占用更少記憶體實現更好的效果,越來越多的開放AI模型也開始支援NVFP4、NVFP8這兩種格式,相較BF16格式,NVFP8可減少40%記憶體占用,NVFP4則進一步僅需BF16約40%記憶體,在降低系統記憶體需求的同時也增加執行效率,除了可在相同的VRAM執行更大參數模型外,在結合將部分未使用模型區塊轉移到系統記憶體的技術,16GB的RTX顯示卡足以執行占用26GB的模型。

僅需20秒就可產生4K50fps短片的LTX-2模型

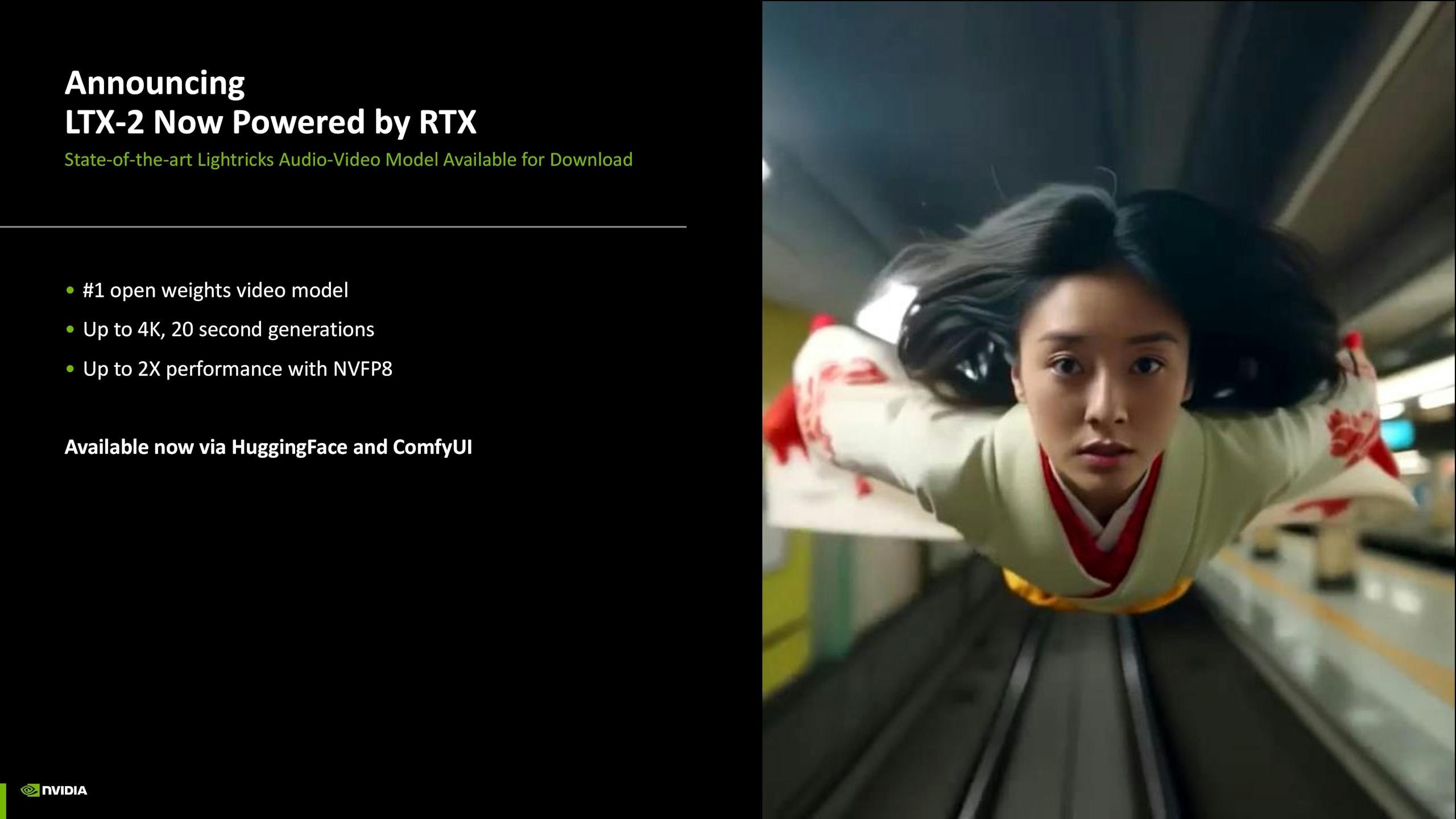

▲NVIDIA的開源生成式AI影片模型LTX-2可產生20秒的4K影片,並原生支援NVFP8量化

▲NVIDIA的開源生成式AI影片模型LTX-2可產生20秒的4K影片,並原生支援NVFP8量化

另外NVIDIA也公布新一代影像生成模型LTX-2,由於導入NVFP8量化格式,較LTX影像模型效能提升一倍,大幅縮減執行時間,並可產生最多20秒的4K解析度影像,此外LTX-2也維持與前一代相同的開源模式,即日起可在HuggingFace與ComfyUI下載。

結合生成式AI的影片超解析

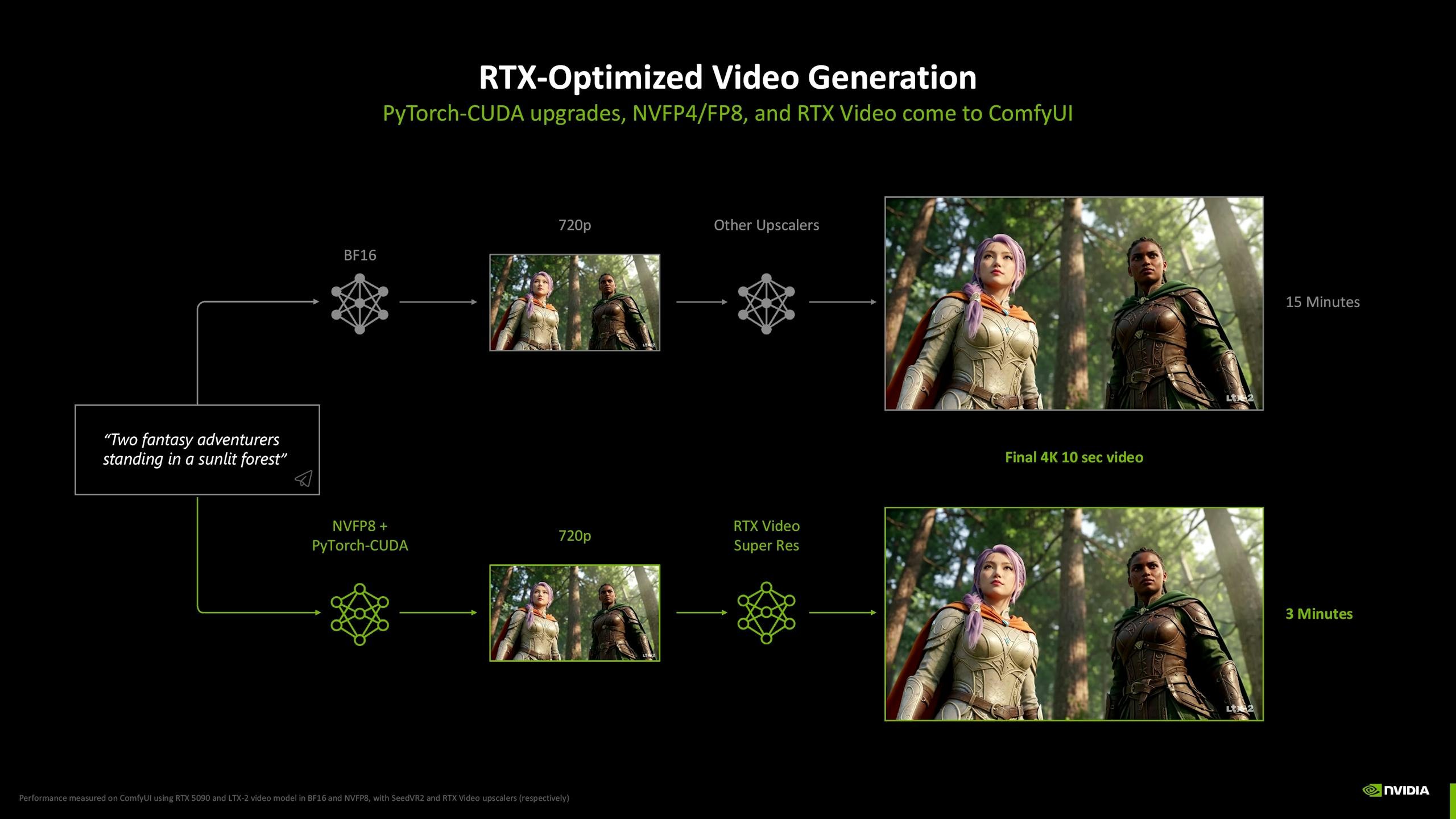

▲結合生成式AI的影片超解析技術不僅可將720p影片細緻的提升至4K,同時透過FP8量化大幅縮減處理時間

▲結合生成式AI的影片超解析技術不僅可將720p影片細緻的提升至4K,同時透過FP8量化大幅縮減處理時間 ▲相較原本需費時15分鐘處理影片升頻,原生支援低精度量化與最佳化微調把處理時間縮短至3分鐘

▲相較原本需費時15分鐘處理影片升頻,原生支援低精度量化與最佳化微調把處理時間縮短至3分鐘

另外,NVIDIA也預計在2026年2月於ComfyUI推出結合生成式AI的影片超解析技術,利用支援NVFP8量化格式以及Py-Torch最佳化的Cuda,相較使用BF16的AI模型需耗時15分鐘才能完成720p至4K的10秒短片處理,NVIDIA的生成式AI影片超解析技術把處理程序大幅縮減為3分鐘。

免責聲明: 本網站轉載的文章均來源於公開平台,僅供參考。這些文章不代表 MEXC 的觀點或意見。所有版權歸原作者所有。如果您認為任何轉載文章侵犯了第三方權利,請聯絡 service@support.mexc.com 以便將其刪除。MEXC 不對轉載文章的及時性、準確性或完整性作出任何陳述或保證,並且不對基於此類內容所採取的任何行動或決定承擔責任。轉載材料僅供參考,不構成任何商業、金融、法律和/或稅務決策的建議、認可或依據。

您可能也會喜歡

Rumble 推出錢包以支援直接加密貨幣支付

Rumble 推出錢包以支援直接加密貨幣支付一文首次發表於 Coinpedia Fintech News Rumble 已推出原生加密貨幣錢包,允許

分享

CoinPedia2026/01/07 23:37

或許在 2026 年一開始,加密市場就被 Wintermute 做局了

2026 年初,比特幣價格劇烈震盪,加密做市商 Wintermute 在元旦期間頻繁向幣安大額注資,三天內淨存 […] 〈或許在 2026 年一開始,加密市場就被 Wintermute 做局了〉這篇文章最早發佈於動區BlockTempo《動區動趨-最具影響力的區塊鏈新聞媒體》。

分享

Blocktempo2026/01/07 22:54

美國12月ADP就業數據溫和反彈「略遜預期」,比特幣走弱跌破9.2萬美元、以太坊失守$3200

美國 12 月 ADP「小非農」就業數據顯示,私營部門就業人數雖出現溫和反彈,但整體增長仍低於市場預期,勞動市 […] 〈美國12月ADP就業數據溫和反彈「略遜預期」,比特幣走弱跌破9.2萬美元、以太坊失守$3200〉這篇文章最早發佈於動區BlockTempo《動區動趨-最具影響力的區塊鏈新聞媒體》。

分享

Blocktempo2026/01/07 22:45