Tether Lança Framework BitNet LoRA Multiplataforma Permitindo Treino e Inferência de IA com Biliões de Parâmetros em Dispositivos de Consumo

A Tether, emissora da stablecoin USDT, anunciou o lançamento do que descreve como o primeiro framework de ajuste fino LoRA multiplataforma concebido para modelos Microsoft BitNet, que são baseados em arquitetura de modelo de linguagem grande de 1 bit. A funcionalidade está integrada no seu sistema QVAC Fabric e é reportado que reduz significativamente tanto o uso de memória como as exigências computacionais. Segundo a empresa, este desenvolvimento permite que modelos de linguagem em larga escala, incluindo aqueles com biliões de parâmetros, sejam ajustados finamente usando hardware de consumo amplamente disponível, como computadores portáteis, unidades de processamento gráfico padrão e smartphones modernos.

O desenvolvimento e manutenção de sistemas de inteligência artificial têm tradicionalmente exigido hardware de nível empresarial, particularmente infraestrutura NVIDIA especializada ou ambientes baseados em computação nuvem. Estes requisitos têm contribuído para custos operacionais elevados, limitando o acesso ao desenvolvimento avançado de IA principalmente a grandes organizações com recursos financeiros substanciais e acesso a sistemas de computação especializados.

A Tether afirmou que o seu modelo de linguagem grande QVAC Fabric, melhorado pelo framework baseado em BitNet recentemente introduzido, aborda estas limitações ao suportar ajuste fino LoRA multiplataforma e acelerando a inferência numa gama de GPUs de consumo heterogéneas. Estas incluem hardware da Intel, AMD e Apple Silicon, entre outros. Como resultado, os utilizadores são capazes de treinar e personalizar modelos de IA diretamente em dispositivos de consumo comummente disponíveis em vez de depender de infraestrutura centralizada.

A empresa reportou que a sua equipa de engenharia demonstrou com sucesso o ajuste fino BitNet em unidades de processamento gráfico móveis pela primeira vez, incluindo plataformas como GPUs Adreno, Mali e Apple Bionic. Testes internos indicaram que um modelo BitNet de 125 milhões de parâmetros poderia ser ajustado finamente em aproximadamente dez minutos num dispositivo Samsung S25 equipado com uma GPU Adreno usando um conjunto de dados biomédicos consistindo em cerca de 300 documentos, ou aproximadamente 18 000 tokens. Para um modelo de 1 bilião de parâmetros, o mesmo conjunto de dados requereu aproximadamente uma hora e dezoito minutos no Samsung S25 e uma hora e quarenta e cinco minutos num iPhone 16. A empresa também reportou que foi capaz de estender os testes a modelos tão grandes quanto 13 biliões de parâmetros no iPhone 16 sob condições de capacidade máxima do dispositivo.

Avanços no Treino de IA Baseado em Edge e Otimização de Desempenho

Descobertas adicionais sugerem que o framework pode suportar ajuste fino de modelos até duas vezes o tamanho de modelos não-BitNet comparáveis operando sob quantização Q4 em dispositivos edge. Este resultado é atribuído à pegada de memória reduzida associada à arquitetura BitNet.

Além de melhorias no treino, o framework também demonstra desempenho de inferência melhorado. Testes conduzidos em dispositivos móveis indicaram que os modelos BitNet têm desempenho substancialmente mais rápido quando executados em GPUs, com velocidades de processamento variando de duas a onze vezes superiores à execução baseada em CPU. Estes resultados indicam que as GPUs móveis são cada vez mais capazes de lidar com cargas de trabalho que anteriormente requeriam hardware especializado ou recursos de nível de centro de dados.

O sistema também mostra ganhos notáveis em eficiência de memória. Dados de benchmark sugerem que um modelo BitNet-1B usando configuração TQ1_0 requer até 77,8 por cento menos VRAM em comparação com um modelo Gemma-3-1B de 16 bits e 65,6 por cento menos do que um modelo Qwen3-0.6B de 16 bits durante processos de inferência e ajuste fino LoRA. Estas reduções fornecem capacidade adicional para executar modelos maiores e habilitar funcionalidades personalizadas em hardware que anteriormente teria sido considerado insuficiente.

A Tether indicou ainda que o framework introduz capacidades de ajuste fino LoRA para modelos de linguagem grandes de 1 bit em hardware não-NVIDIA pela primeira vez, estendendo compatibilidade a AMD, Intel, Apple Silicon e plataformas de GPU móveis. Ao reduzir a dependência de infraestrutura especializada e serviços de computação nuvem, a abordagem permite que dados sensíveis permaneçam armazenados localmente nos dispositivos dos utilizadores. A empresa observou que esta eficiência pode também suportar o desenvolvimento de sistemas de aprendizagem federada, nos quais os modelos podem ser treinados colaborativamente através de dispositivos distribuídos enquanto mantêm a privacidade dos dados e minimizam a dependência de sistemas centralizados.

O artigo Tether Lança Framework BitNet LoRA Multiplataforma Permitindo Treino de IA com Biliões de Parâmetros e Inferência em Dispositivos de Consumo apareceu primeiro no Metaverse Post.

Você também pode gostar

Como demissão, doença na família e experiência pessoal levaram Tatiana Pimenta a criar uma plataforma de saúde mental

Tatiana Pimenta, CEO da Vittude Divulgação/Nicolas Siegmann Em 2015, Tatiana Pimenta viveu um daqueles dias que mudam a vida. Foi demitida durante uma rees

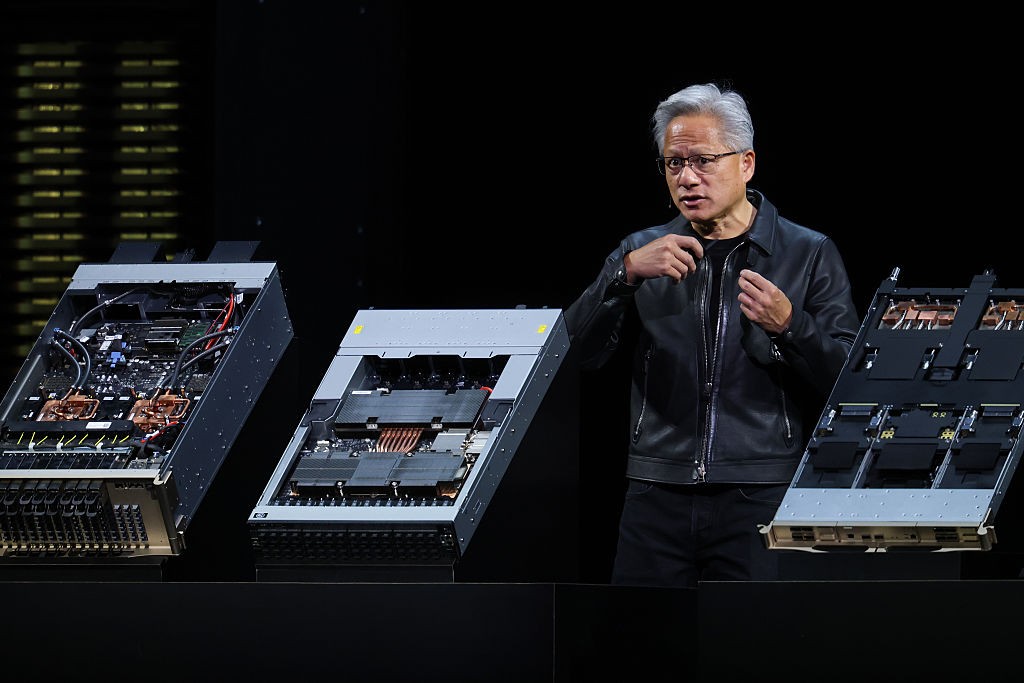

“Não seja demitido, não fique entediado e não morra”: as três regras fundamentais da vida, segundo Jensen Huang

Jensen Huang, CEO da Nvidia Getty Images Não deixe seu celular ligado se estiver em uma reunião com Jensen Huang. Nem mesmo se estiver em uma coletiva com

Agentes da IA fazem surgir nova dúvida no centro do comando: quem deve ser responsável por essa nova tecnologia?

A atribuição do controle da tecnologia pode determinar o futuro da empresa Getty Images No começo deste ano, o CEO de uma seguradora da Fortune 500 reuniu