Imagens de IA nuas: A 'Lei Take It Down' nos EUA permitirá que os utilizadores solicitem a remoção rápida

Desde o final de dezembro de 2025, o chatbot de inteligência artificial do X, Grok, respondeu aos pedidos de muitos usuários para despir pessoas reais, transformando fotografias das pessoas em material sexualmente explícito. Após as pessoas começarem a usar a funcionalidade, a empresa de plataforma social enfrentou escrutínio global por permitir que os usuários gerassem representações sexualmente explícitas não consensuais de pessoas reais.

A conta Grok publicou milhares de imagens "nudificadas" e sexualmente sugestivas por hora. Ainda mais perturbador, o Grok gerou imagens sexualizadas e material sexualmente explícito de menores.

A resposta do X: culpem os usuários da plataforma, não nós. A empresa emitiu uma declaração em 3 de janeiro de 2026, dizendo que "Qualquer pessoa que utilize ou instrua o Grok a criar conteúdo ilegal sofrerá as mesmas consequências como se carregasse conteúdo ilegal." Não está claro que ação, se alguma, o X tomou contra quaisquer usuários.

Como académico jurídico que estuda a interseção da lei e tecnologias emergentes, vejo esta enxurrada de imagens não consensuais como um resultado previsível da combinação das políticas de moderação de conteúdo laxas do X e da acessibilidade de ferramentas de IA generativa poderosas.

Visando usuários

A ascensão rápida da IA generativa levou a inúmeros websites, aplicações e chatbots que permitem aos usuários produzir material sexualmente explícito, incluindo "nudificação" de imagens reais de crianças. Mas estas aplicações e websites não são tão amplamente conhecidos ou usados como qualquer uma das principais plataformas de redes sociais, como o X.

As legislaturas estaduais e o Congresso responderam de forma relativamente rápida. Em maio de 2025, o Congresso promulgou a Take It Down Act, que torna crime a publicação de material sexualmente explícito não consensual de pessoas reais. A Take It Down Act criminaliza tanto a publicação não consensual de "representações visuais íntimas" de pessoas identificáveis quanto representações geradas por IA ou computador de pessoas identificáveis.

Essas disposições criminais aplicam-se apenas a quaisquer indivíduos que publiquem o conteúdo sexualmente explícito, não às plataformas que distribuem o conteúdo, como websites de redes sociais.

Outras disposições da Take It Down Act, no entanto, exigem que as plataformas estabeleçam um processo para que as pessoas retratadas solicitem a remoção das imagens. Uma vez submetido um "Take It Down Request", uma plataforma deve remover a representação sexualmente explícita dentro de 48 horas. Mas estes requisitos não entram em vigor até 19 de maio de 2026.

Problemas com plataformas

Entretanto, os pedidos de usuários para remover as imagens sexualmente explícitas produzidas pelo Grok aparentemente ficaram sem resposta. Até mesmo a mãe de um dos filhos de Elon Musk, Ashley St. Clair, não conseguiu que o X removesse as imagens sexualizadas falsas dela que os fãs de Musk produziram usando o Grok. O Guardian relata que St. Clair disse que as suas "reclamações à equipa do X não levaram a lado nenhum."

Isto não me surpreende porque Musk desmantelou o grupo consultivo de Confiança e Segurança do então-Twitter pouco depois de adquirir a plataforma e despediu 80% dos engenheiros da empresa dedicados à confiança e segurança. As equipas de confiança e segurança são tipicamente responsáveis pela moderação de conteúdo e iniciativas para prevenir abusos em empresas tecnológicas.

Publicamente, parece que Musk descartou a seriedade da situação. Musk terá supostamente publicado emojis de riso com lágrimas em resposta a algumas das imagens, e o X respondeu à pergunta de um repórter da Reuters com a resposta automática "Legacy Media Lies."

Limites de processos judiciais

Processos cíveis como o apresentado pelos pais de Adam Raine, um adolescente que cometeu suicídio em abril de 2025 após interagir com o ChatGPT da OpenAI, são uma forma de responsabilizar as plataformas. Mas os processos judiciais enfrentam uma batalha difícil nos Estados Unidos dada a Secção 230 da Lei de Decência nas Comunicações, que geralmente imuniza as plataformas de redes sociais de responsabilidade legal pelo conteúdo que os usuários publicam nas suas plataformas.

O juiz do Supremo Tribunal Clarence Thomas e muitos académicos jurídicos, no entanto, argumentaram que a Secção 230 tem sido aplicada de forma demasiado ampla pelos tribunais. Concordo geralmente que a imunidade da Secção 230 precisa de ser restringida porque imunizar empresas tecnológicas e as suas plataformas pelas suas escolhas deliberadas de design — como o seu software é construído, como o software opera e o que o software produz — fica fora do âmbito das proteções da Secção 230.

Neste caso, o X falhou conscientemente ou negligentemente em implementar salvaguardas e controlos no Grok para impedir que os usuários gerassem imagens sexualmente explícitas de pessoas identificáveis. Mesmo que Musk e o X acreditem que os usuários deveriam ter a capacidade de gerar imagens sexualmente explícitas de adultos usando o Grok, acredito que em nenhum mundo o X deveria escapar à responsabilidade por construir um produto que gera material sexualmente explícito de crianças da vida real.

Salvaguardas regulamentares

Se as pessoas não podem responsabilizar plataformas como o X através de processos cíveis, então cabe ao governo federal investigá-las e regulá-las. A Comissão Federal de Comércio, o Departamento de Justiça ou o Congresso, por exemplo, poderiam investigar o X pela geração de material sexualmente explícito não consensual do Grok. Mas com os laços políticos renovados de Musk com o Presidente Donald Trump, não espero quaisquer investigações sérias e responsabilização tão cedo.

Por agora, os reguladores internacionais lançaram investigações contra o X e o Grok. As autoridades francesas iniciaram investigações sobre "a proliferação de deepfakes sexualmente explícitos" do Grok, e o Conselho Irlandês para as Liberdades Civis e Direitos Digitais da Irlanda instaram fortemente a polícia nacional da Irlanda a investigar a "farra de despimento em massa." A agência reguladora do Reino Unido Office of Communications disse que está a investigar o assunto, e os reguladores na Comissão Europeia, Índia e Malásia estão alegadamente a investigar o X também.

Nos Estados Unidos, talvez o melhor curso de ação até a Take It Down Act entrar em vigor em maio seja que as pessoas exijam ação dos funcionários eleitos. – Rappler.com

O artigo foi originalmente publicado em The Conversation.

Wayne Unger, Professor Associado de Direito, Quinnipiac University

Você também pode gostar

Proposta exige que hotel tenha pulseira de identificação para crianças

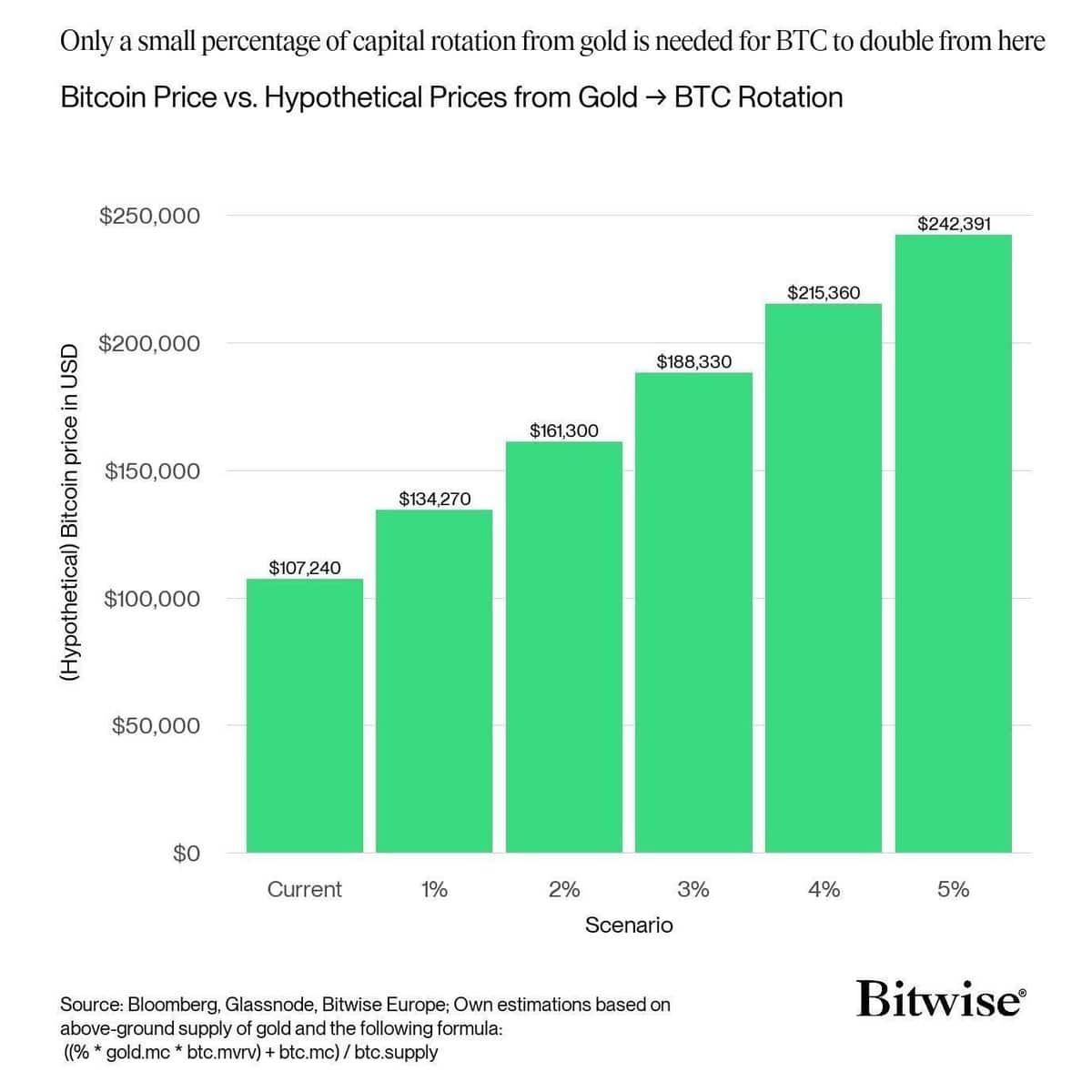

Como 1% do mercado de ouro pode disparar o preço do Bitcoin