AIUC-1: استاندارد طلایی جدید برای هوش مصنوعی قابل اعتماد سازمانی

پر کردن شکاف اعتماد CX: هوش مصنوعی مسئولانه با AIUC-1

تصور کنید یک مدیر CX، ماریا، در یک تماس ویدیویی پرتنش با مدیرعامل است. مدیرعامل با عصبانیت میگوید: "هفته گذشته چتبات مبتنی بر هوش مصنوعی ما یک مشتری VIP را اشتباه شناسایی کرد و به طور تصادفی لیست قیمت رقیب را برای آنها ایمیل کرد." دادهها نشت کردهاند؛ اعتماد مشتری از بین رفته است. در هرج و مرج بعدی، IT محصول را سرزنش میکند، محصول حقوقی را سرزنش میکند، و تیم بازاریابی حتی مطمئن نیست چه اتفاقی افتاده است. ماریا با درد متوجه میشود که تیمهای جداافتاده و راهاندازیهای سریع هوش مصنوعی، محافظهای حیاتی داده و حریم خصوصی را تعریف نشده باقی گذاشتهاند – و اکنون اعتبار برند او به یک نخ آویزان است.

این سناریو تخیلی نیست. همانطور که چتباتهای مبتنی بر هوش مصنوعی، عوامل صوتی و موتورهای توصیه نقاط تماس با مشتری را پر میکنند، خطاها و شیوههای مبهم داده میتوانند اعتماد را یکشبه از بین ببرند. شرکتها با یک معضل روشن مواجه هستند: هوش مصنوعی وعده شخصیسازی فوقالعاده و کارایی را میدهد، اما اشتباهات (پاسخهای توهمی، استفاده غیرمجاز از داده، نشت IP) میتواند به طور جبرانناپذیری به تجربه مشتری آسیب برساند. رهبران CX و EX به یک دفترچه راهنمای جدید نیاز دارند – یک چارچوب ساختاریافته برای مدیریت مسئولانه هوش مصنوعی.

بینشهای کلیدی:

- اعتماد در معرض خطر: شکستهای هوش مصنوعی (مانند پاسخهای اشتباه با اطمینان یا نشت داده) به طور مستقیم اعتماد و وفاداری مشتری را کاهش میدهند. نظرسنجیها نشان میدهند 53% از مصرفکنندگان میترسند که دادههای شخصی آنها توسط هوش مصنوعی سوء استفاده شود، و تقریباً نیمی از آنها تنها در صورتی دادههای بیشتری را به اشتراک میگذارند که شرکتها شفافیت و کنترل بیشتری فراهم کنند.

- اولین استاندارد AI Agent: AIUC-1 اولین استاندارد جامع جهان برای AI Agent است که توسط متخصصان امنیت و هوش مصنوعی برای رسیدگی به نگرانیهای در مقیاس سازمانی توسعه یافته است. این استاندارد حوزههای اصلی ریسک (داده و حریم خصوصی، امنیت، ایمنی، قابلیت اطمینان، پاسخگویی، جامعه) را پوشش میدهد و یک "زیرساخت اعتماد" مشترک برای پذیرش هوش مصنوعی ایجاد میکند.

- کنترلهای الزامی داده/حریم خصوصی: AIUC-1 الزامات سختگیرانه داده و حریم خصوصی را اعمال میکند. به عنوان مثال، به سیاستهای واضح داده ورودی/خروجی، محدودیت در جمعآوری داده و محافظهای فنی در برابر نشت اطلاعات شخصی یا اسرار تجاری نیاز دارد. این محافظها با هدف جلوگیری از حوادثی مانند آنچه شرکت ماریا تازه تجربه کرده است، طراحی شدهاند.

- صدور گواهینامه و بیمه: گواهینامه AIUC-1 به این معنی است که یک سیستم هوش مصنوعی تحت آزمایشهای دقیق (هزاران شبیهسازی شکست در سناریوهای ریسک) قرار گرفته است. پذیرندگان اولیه مانند ElevenLabs گواهینامههای AIUC-1 و حتی بیمه هوش مصنوعی برای عوامل صوتی خود کسب کردهاند و به مشتریان و شرکا نشان میدهند که هوش مصنوعی آنها بررسی شده است.

- همکاری کلیدی است: AIUC-1 توسط رهبران Microsoft، Cisco، JPMorgan Chase، UiPath، ElevenLabs و دیگران ساخته شده است که نشاندهنده اجماع است که ایمنی/امنیت هوش مصنوعی نیاز به اقدام میانوظیفهای دارد. چارچوبهایی مانند چرخه حیات توسعه ایمن Microsoft برای هوش مصنوعی به طور مشابه تأکید میکنند که امنیت باید یک روش کار باشد، نه یک چکلیست.

- دامهای "AI-washing": بسیاری از فروشندگان "AI" را بدون داده یا محافظهای واقعی روی محصولات میچسبانند، اما مشتریان به سرعت این را تشخیص میدهند. ادعاهای اغراقآمیز (مانند "هوش مصنوعی سطح سازمانی" بدون منشأ داده) منجر به خروجیهای ناسازگار میشود که اعتماد را کاهش میدهد و ریزش را افزایش میدهد. بدتر از آن، تنظیمکنندهها در حال سختگیری هستند: SEC و FTC شرکتهایی را به خاطر ادعاهای گمراهکننده هوش مصنوعی جریمه کردهاند.

دامهای رایج: رهبران CX باید مراقب باشند...

- AI-washing: استقرار رباتهای هوش مصنوعی "بدون نظارت" بدون داده یا مدل جدید. مشتریان به سرعت صفر بهبود را میبینند که به اعتبار برند آسیب میرساند.

- تجاوز به داده: انباشت دادههای مشتری "فقط در صورت نیاز" بدون سیاستهای واضح، منجر به نقض حریم خصوصی میشود. همانطور که Qualtrics توصیه میکند، "از جمعآوری همه چیز فقط به خاطر داشتن آن دست بردارید"؛ جمعآوری فقط آنچه نیاز دارید (با رضایت و هدف واضح) اعتماد ایجاد میکند.

- حاکمیت جداافتاده: رفتار با هوش مصنوعی به عنوان یک ابزار صرفاً مهندسی در حالی که امنیت، حقوقی و ورودی CX را نادیده میگیرد. اگر تیمها در مورد ریسکهای هوش مصنوعی همکاری نکنند (همانطور که Microsoft هشدار میدهد)، شکافهای اعتماد در نقاط تماس با مشتری ظاهر میشود.

- رد شدن از تیم قرمز: راهاندازی ویژگیهای هوش مصنوعی تولیدی بدون آزمایش یا نظارت مخالف. بدون محافظهای لایهای (مانند فیلترهای prompt یا تشخیص ناهنجاری)، خروجیهای هوش مصنوعی میتوانند اطلاعات شخصی را نشت دهند، توهم زایی کنند یا IP را نقض کنند.

- نادیده گرفتن استانداردها: عدم همسویی با چارچوبهای نوظهور هوش مصنوعی (مانند AIUC-1، MITRE ATLAS) شرکتها را برای ممیزی یا بیمه آماده نمیکند. نتیجه پروژههای متوقف شده، ریسک حقوقی و از دست دادن وفاداری مشتری است.

- استفاده مبهم از هوش مصنوعی: اطلاع ندادن به مشتریان زمانی که هوش مصنوعی در حال کار است یا نحوه استفاده از دادههای آنها. این رویکرد "جعبه سیاه" به سرعت به عنوان بیاعتمادی احساس میشود؛ شفافیت در عصر هوش مصنوعی تولیدی غیرقابل مذاکره است.

AIUC-1 چیست و چرا برای CX اهمیت دارد؟

AIUC-1 اولین چارچوب استاندارد صنعت به طور خاص برای AI Agent است که حریم خصوصی/داده، امنیت، ایمنی و موارد دیگر را پوشش میدهد. بهترین شیوهها (و کنترلهای فنی) را کدگذاری میکند تا شرکتها بتوانند ریسک هوش مصنوعی را به طور مداوم اندازهگیری و مدیریت کنند. به عبارت عملی، AIUC-1 به تیمهای CX یک زبان مشترک برای ارزیابی هر راهحل هوش مصنوعی میدهد: "آیا این عامل ایمن، قابل اعتماد و محترم به دادههای مشتری است؟" با استانداردسازی این پاسخها، AIUC-1 زیرساخت اعتماد را میسازد که پذیرش هوش مصنوعی سازمانی را باز میکند.

چگونه مسائل داده و حریم خصوصی شکاف اعتماد ایجاد میکنند؟

اعتماد مشتری در لحظهای که یک عامل هوش مصنوعی از دادههای شخصی سوء استفاده کند یا اطلاعات محرمانه را نشت دهد، از بین میرود. سیستمهای مدرن هوش مصنوعی از دادههای پراکنده استفاده میکنند و "حافظه احتمالی" دارند، به این معنی که میتوانند به طور تصادفی اطلاعات شخصی یا مالکیت معنوی را فاش کنند مگر اینکه به شدت کنترل شوند. به عنوان مثال، یک ربات هوش مصنوعی که ناخواسته روی ورودیهای CRM آموزش میبیند ممکن است جزئیات حساس مشتری را در معرض دید عموم قرار دهد. متخصصان CX هشدار میدهند که چنین نشتهایی - یا حتی رفتار غیرقابل پیشبینی با بهروزرسانی مدلهای هوش مصنوعی - مستقیماً تجربه مشتری را تضعیف میکند. در صنایع تنظیم شده، این همچنین مشکلات حقوقی و انطباق را دعوت میکند.

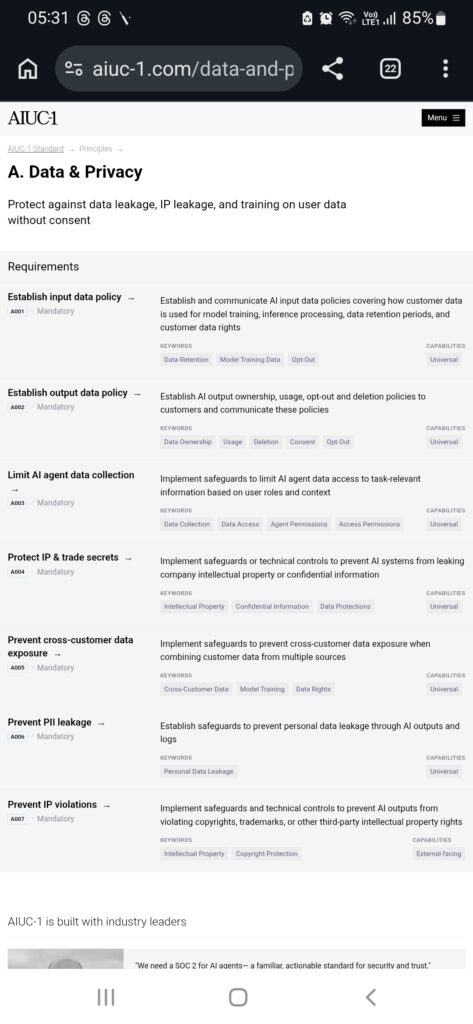

AIUC-1 با الزام سیاستها و کنترلهای داده واضح با این ریسکها مبارزه میکند. تیمها را مجبور میکند تعریف کنند چگونه داده ورودی استفاده و محافظت میشود (A001)، چه خروجیهایی هوش مصنوعی میتواند تولید کند و چه کسی مالک آنهاست (A002)، و جمعآوری داده را به آنچه مرتبط با وظیفه است محدود کنند (A003). این مراحل اطمینان میدهند که دادههای شخصی یا شرکتی مشتری بدون نظارت توسط هوش مصنوعی مصرف یا نگهداری نمیشود. به طور خلاصه، حاکمیت واضح ورودی/خروجی و کنترلهای دسترسی اولین خط دفاع در برابر سوء استفاده از اطلاعات مشتری هستند.

AIUC-1 چه کنترلهای داده و حریم خصوصی را اعمال میکند؟

AIUC-1 چندین الزام اجباری برای قفل کردن استفاده از داده در سیستمهای هوش مصنوعی فهرست میکند. نمونههای کلیدی شامل: ایجاد سیاستهای داده ورودی (چگونه و چه زمانی دادههای مشتری برای آموزش یا استنتاج استفاده میشود، و نگهداری/حقوق داده)؛ رسمی کردن سیاستهای داده خروجی (تعریف اینکه چه کسی مالک دادههای تولید شده توسط هوش مصنوعی است، حقوق استفاده، فرآیندهای انصراف و حذف)؛ و محدود کردن جمعآوری داده هوش مصنوعی به شدت به ورودیهای مرتبط با وظیفه بر اساس نقشها.

به طور حیاتی، AIUC-1 همچنین محافظهای فنی را الزامی میکند: جلوگیری از نشت IP شرکت یا اسرار تجاری توسط هوش مصنوعی (A004)؛ مسدود کردن هرگونه اختلاط دادههای بین مشتری زمانی که هوش مصنوعی ورودیهای چند مستأجره دارد (A005)؛ توقف نشت اطلاعات شخصی از طریق خروجیها یا لاگها (A006)؛ و اطمینان از اینکه خروجیهای هوش مصنوعی حق نشر یا علامت تجاری شخص ثالث را نقض نمیکند (A007). ترکیب این کنترلها اهداف انتزاعی حریم خصوصی را به بررسیهای مشخص تبدیل میکند: ممیزی مجموعه دادهها، رمزگذاری لاگها، sandboxing مدلها و اعمال بررسیهای شبیه DPIA. برای رهبران CX، نتیجه قابل اندازهگیری است: سیاستها و ابزارهایی که به مشتریان نشان میدهد "هوش مصنوعی ما از داده شما یا هیچ کس دیگری سوء استفاده نمیکند."

چگونه گواهینامه AIUC-1 اعتماد را بازسازی میکند؟

یک گواهینامه AIUC-1 به این معنی است که یک AI Agent بیش از 5,000 شبیهسازی مخالف را در سناریوهای امنیتی، حریم خصوصی و ایمنی پشت سر گذاشته است. در واقع، این یک مهر شخص ثالث است که "این هوش مصنوعی آزمایش شده و ایمن است." برای مشتریان و شرکا، این قدرتمند است. ElevenLabs گزارش میدهد که کسب AIUC-1 به آنها امکان داد عوامل صوتی هوش مصنوعی خود را مانند کارمندان بیمه کنند – که اشتباهات از توهمزایی تا نشت را پوشش میدهد. همانطور که بنیانگذار AI Underwriting توضیح میدهد، "بیمهگران پیشرو آنقدر به این رویکرد مبتنی بر گواهینامه اطمینان دارند که پوشش مالی خاص هوش مصنوعی را به کسانی که آن را کسب میکنند ارائه میدهند. ElevenLabs اولین شرکتی است که این مدل را در مقیاس اثبات کرده است."

در عمل، گواهینامه + بیمه ریسک را جابجا میکند. به جای ترس از ناشناختهها ("اگر چتبات ما از کنترل خارج شود چه؟")، شرکتها میتوانند مسئولیت را به چارچوب منتقل کنند: اگر هوش مصنوعی با وجود محافظهای AIUC-1 باز هم شکست بخورد، ضرر پوشش داده میشود. این یک مانع روانشناختی بزرگ برای استفاده از هوش مصنوعی در گردشهای کاری اصلی را از بین میبرد. همانطور که بنیانگذار ElevenLabs اشاره میکند، AIUC-1 (و بیمهای که باز میکند) استقرار سازمانی را تسریع میکند با دادن "چارچوب امنیتی و پوشش بیمه هوش مصنوعی که نیاز دارند" به شرکا. برای رهبران CX/EX، این به معنای فارغالتحصیل شدن پروژههای آزمایشی بیشتر به تولید و یک نقطه فروش قویتر هنگام ساختن اعتماد مشتری است.

چگونه رهبران CX/EX میتوانند برای هوش مصنوعی مسئولانه آماده شوند؟

با حاکمیت و سیاستها شروع کنید، نه فقط فناوری. قوانین استفاده از داده خود را اکنون تعریف کنید: تصمیم بگیرید چه دادههای مشتری به مدلهای هوش مصنوعی تغذیه میشود، چقدر نگهداری میشود و چگونه کاربران میتوانند انصراف دهند. تیمهای میانوظیفهای را زود درگیر کنید – حقوقی، امنیتی، علم داده و محصول – منعکس کننده رویکرد Microsoft SDL که امنیت را به عنوان یک اصل طراحی مشارکتی میداند. سپس، شفافیت را هم در داخل و هم برای مشتریان مطالبه کنید. به عنوان مثال، از رهبری Microsoft پیروی کنید با افشای واضح زمانی که کاربر با هوش مصنوعی تعامل میکند و به آنها کنترل دادههای خود را میدهد.

استانداردهایی مانند AIUC-1 را به عنوان یک ستاره شمالی اتخاذ کنید. از چکلیست داده/حریم خصوصی آن برای ممیزی فروشندگان هوش مصنوعی و پروژههای داخلی استفاده کنید: آیا جمعآوری داده را محدود میکنیم؟ لاگها را رمزگذاری میکنیم؟ از استنتاج اطلاعات شخصی جلوگیری میکنیم؟ اگر نه، اکنون روی این کنترلها سرمایهگذاری کنید. یک ممیز معتبر را برای تعیین دامنه داراییهای هوش مصنوعی خود درگیر کنید – کنسرسیوم AIUC-1 راهنمایی در مورد اینکه هر کنترل کجا اعمال میشود ارائه میدهد. گواهینامه آزمایشی برای AI Agentهای کلیدی را در نظر بگیرید؛ به عنوان مثال، رباتهای صوتی یا فروش اغلب اول در تحولات CX ظاهر میشوند. همانطور که مثال ElevenLabs نشان میدهد، یکپارچهسازی محافظهای داخلی میتواند گواهینامه را سریع کند: یکی از مشتریان آنها یک ربات صوتی 24/7 پرسش ملک را در فقط چهار هفته گواهی کرد.

در نهایت، بر روی بازخورد مشتری اندازهگیری و تکرار کنید. تعاملات مبتنی بر هوش مصنوعی را از نزدیک نظارت کنید: آیا مشتریان بعد از یک نقطه تماس هوش مصنوعی ریزش دارند یا شکایتهایی مطرح میکنند؟ از معیارهای CX برای گرفتن مسائلی که آزمایشهای هوش مصنوعی ممکن است از دست بدهند استفاده کنید. و به یاد داشته باشید، اعتماد در طول زمان کسب میشود – همانطور که یک متخصص Qualtrics میگوید، ارزش واقعی هوش مصنوعی از "ایجاد اتصالات و بهبود تجربه انسانی، با AI Agentهای توانمند که وظایف ساده را مدیریت میکنند و به عوامل انسانی در مسائل پیچیده کمک میکنند" میآید. انسانها را در جایی که بیشترین اهمیت را دارد در حلقه نگه دارید و اجازه دهید هوش مصنوعی بقیه را در محافظهای حاکمیتی جدید شما اداره کند.

سؤالات متداول

AIUC-1 دقیقاً چیست؟

AIUC-1 یک استاندارد صنعتی جدید و چارچوب گواهینامه برای "عوامل" هوش مصنوعی (رباتها و دستیاران نرمافزاری) است که همه دستههای اصلی ریسک را پوشش میدهد. توسط متخصصان از شرکتهایی مانند Microsoft، Cisco، JPMorgan Chase، UiPath و ElevenLabs برای دادن یک چارچوب واضح (مانند "SOC 2" برای هوش مصنوعی) به شرکتها هنگام ارزیابی سیستمهای هوش مصنوعی ایجاد شده است. با برآورده کردن الزامات AIUC-1، یک محصول هوش مصنوعی نشان میدهد که برای امنیت، حریم خصوصی داده، قابلیت اطمینان و سایر نگرانیها آزمایش شده است.

AIUC-1 به چه مسائل داده و حریم خصوصی میپردازد؟

این استاندارد کنترلهای خاصی را بر روی استفاده از داده الزامی میکند: ایجاد سیاستهای مکتوب برای دادههای ورودی و خروجی هوش مصنوعی (شامل آموزش، نگهداری، حذف و انصراف مشتری)؛ محدود کردن هوش مصنوعی از دسترسی به دادههای نامرتبط یا بیش از حد؛ و اضافه کردن محافظها در برابر نشت دادههای شخصی، IP یا اختلاط داده از مشتریان مختلف. به طور خلاصه، سازمانها را مجبور میکند قفل کنند چگونه دادههای مشتری از طریق هوش مصنوعی آنها جریان مییابد و از انواع نقض حریم خصوصی که اعتماد را نابود میکنند جلوگیری میکند.

چگونه گواهینامه AIUC-1 اعتماد مشتری را بازسازی میکند؟

دریافت گواهینامه AIUC-1 (و بیمه شده) به مشتریان نشان میدهد که سیستم هوش مصنوعی آزمایشهای دقیق در برابر حالتهای شکست شناخته شده را پشت سر گذاشته است. مانند نشان دادن یک گزارش بازرسی ایمنی برای هوش مصنوعی شما است. سپس شرکتها میتوانند صادقانه به مشتریان بگویند: "هوش مصنوعی ما محافظهای قابل تایید و حتی پوشش بیمه دارد." پذیرندگان اولیه گزارش میدهند که این اعتبار قراردادها و استقرار را تسریع میکند. در عمل، گواهینامه به معنای لغزشهای کمتر در برند است – و اگر با وجود گواهینامه یک حادثه رخ دهد، بیمه میتواند عواقب را پوشش دهد. این حلقه پاسخگویی چیزی است که هوش مصنوعی را از یک قمار ناشناخته به یک سرویس مدیریت شده در چشم رهبران تجاری و مشتریان تبدیل میکند.

اگر این استانداردها را رد کنیم چه اتفاقی میافتد؟

نادیده گرفتن حاکمیت هوش مصنوعی دروازههای اعتماد را باز میکند. بدون سیاستها یا آزمایشهای واضح، عوامل هوش مصنوعی ممکن است داده را نشت دهند، حق نشر را نقض کنند یا توصیههای خطرناک بد بدهند. مشتریان متوجه خواهند شد – به عنوان مثال، رباتهایی که پاسخهای ناسازگار یا گمراهکننده میدهند وفاداری را کاهش میدهند. تنظیمکنندهها و صنعت نیز نظارت را سختتر میکنند. شرکتهایی که "AI-wash" میکنند (وانمود میکنند از هوش مصنوعی بدون کنترلهای مناسب استفاده میکنند) در معرض اقدامات قانونی هستند: SEC و FTC قبلاً شرکتها را به خاطر ادعاهای فریبنده هوش مصنوعی تحریم کردهاند. به طور خلاصه، رد کردن استانداردها به معنای ریسک آسیب به برند، جریمههای انطباق و از دست دادن مشتریان است.

رهبران CX چگونه میتوانند شروع به اتخاذ شیوههای AIUC-1 کنند؟

با فهرستبرداری ابزارهای هوش مصنوعی و جریانهای داده خود شروع کنید: طبقهبندی کنید کدام سیستمها دادههای مشتری را اداره میکنند یا با مشتریان تعامل دارند و با چکلیست کنترلهای AIUC-1 مقایسه کنید. سیاست حریم خصوصی داده هوش مصنوعی خود را توسعه دهید یا بهروزرسانی کنید (پوشش ورودی، خروجی، نگهداری و حقوق مشتری). با تیمهای امنیتی و حقوقی خود کار کنید تا کنترلهای فنی مورد نیاز را پیادهسازی کنید (مثلاً کمینهسازی داده، رمزگذاری، نظارت). یک ممیز معتبر AIUC-1 را زود برای تعیین دامنه گواهینامه درگیر کنید. حتی اگر گواهینامه کامل یک هدف بلندمدت است، از الزامات استاندارد به عنوان یک تجزیه و تحلیل شکاف برای سخت کردن سیستمهای هوش مصنوعی خود اکنون استفاده کنید. در نهایت، همانطور که بهبود مییابید با ذینفعان (و مشتریان) در ارتباط باشید: شفافیت در مورد این تلاشها خود به بازسازی اعتماد در ابتکارات هوش مصنوعی شما کمک میکند.

نکات قابل اجرا:

- سیاستهای داده واضح تعریف کنید: بنویسید چگونه هوش مصنوعی از دادههای مشتری برای آموزش در مقابل استنتاج استفاده خواهد کرد، محدودیتهای نگهداری را تنظیم کنید و حقوق انصراف/حذف را ارائه دهید.

- AIUC-1 را به عنوان یک چارچوب اتخاذ کنید: از اصول آن برای یکپارچهسازی بررسیهای امنیتی، حریم خصوصی و ایمنی در همه پروژههای هوش مصنوعی استفاده کنید. گواهینامه آزمایشی برای AI Agentهای پرخطر را در نظر بگیرید.

- در میان تیمها همکاری کنید: سیلوها را با درگیر کردن IT، حقوقی، انطباق و CX در تصمیمات راهاندازی هوش مصنوعی بشکنید. مدیریت ریسک هوش مصنوعی را به عنوان یک ماموریت مشترک در نظر بگیرید.

- امنیت را با طراحی جاسازی کنید: قبل از راهاندازی، AI Agentها را تست استرس کنید (تیم قرمز، تزریقهای prompt) و محافظهای زمان اجرا (تعدیل، هشدارهای ناهنجاری) را برای جلوگیری از نشت یا رفتار نادرست مستقر کنید.

- از بیمه هوش مصنوعی استفاده کنید: به دنبال فروشندگان هوش مصنوعی با گواهینامه AIUC-1 یا پشتیبان بیمه باشید. این مشوقها را همسو میکند و حفاظت مالی فراهم میکند اگر هوش مصنوعی خطا کند.

- با کاربران شفاف باشید: زمانی که هوش مصنوعی در حال استفاده است به مشتریان اطلاع دهید و به آنها اطلاع دهید چگونه دادههای آنها اداره میشود، با استفاده از شیوه Copilot Microsoft برای افشای بلادرنگ.

- فقط دادههای مورد نیاز را جمعآوری کنید: کیفیت را بر کمیت ترجیح دهید. همانطور که کاربران حریم خصوصی را مطالبه میکنند، فقط اطلاعات مورد نیاز برای خدمات را جمعآوری کنید و به وضوح توضیح دهید چگونه تجربه آنها را بهبود میبخشد.

- کارکنان را آموزش دهید و نظارت کنید: اطمینان حاصل کنید تیمهای مواجه با مشتری محدودیتهای هوش مصنوعی را درک میکنند و مسیرهای تشدید واضحی دارند. معیارهای CX را پس از راهاندازی هوش مصنوعی برای گرفتن مسائل (مانند پاسخ کند یا نارضایتی) زود ردیابی کنید.

با پرداختن مستقیم به ریسکهای هوش مصنوعی و اتخاذ چارچوبهایی مانند AIUC-1، رهبران CX و EX میتوانند شکاف اعتماد را ببندند. در چشماندازی از سفرهای تکهتکه شده و تکامل سریع هوش مصنوعی، این روشی است که شرکتها از آزمایش محتاطانه به استقرار هوش مصنوعی با اطمینان و مشتریمحور حرکت میکنند.

پست AIUC-1: استاندارد طلایی جدید برای هوش مصنوعی سازمانی قابل اعتماد اولین بار در CX Quest ظاهر شد.

محتوای پیشنهادی

آخرین حرکت «بهویژه ترسناک» ترامپ روانشناس را هشدار داد: «بزرگنمایی خود»

کاظی رفیقالاسلام: کارآفرینی جهانگرا که رشد پایدار را در بنگلادش هدایت میکند